2018年3月19日にアメリカのアリゾナ州で、

Uberの自動運転車が人をはねて殺してしまう交通事故が発生。

世界初の自動運転車による死亡事故じゃないでしょうか。

※実は2016年に起きた人身事故が世界初の自動運転車による死亡事故でした。

Inside the Self-Driving Tesla Fatal Accident

A self-driving Uber car hit and killed a woman in the first known autonomous-vehicle death

- アメリカのアリゾナ州で歩行者が自動運転車にはねられた

- 被害者は病院で亡くなった

- 自動運転車は歩行者が車道に飛び出たのを判断できずブレーキも踏まずにそのまま進行してはねた

- 歩行者は横断歩道ではない場所を渡ろうとしていた

自動運転車の過失割合はどうなんでしょうね。

横断歩道ではない場所を渡った場合、

確かアメリカでは100%歩行者の責任になるはず。

もちろん、自動運転車がより進化してそういうケースでも減速できれば、

それに越したことはないんですが。

アリゾナ警察が事故車の車載カメラの映像を公開

追記ですが、アリゾナ警察が事故車の車載カメラの映像を公開。

夜中に走っていたせいで視界が暗く、

自転車を押して道路を横断する人が突然目前に出現したように見えます。

肉眼だと気付かないのは仕方ないけど、

自動運転だと赤外線カメラとかで見えるんじゃないですかね……。

車内カメラで女性が前を見て驚く様子も映ってるけど、

これはただのオペレーターであって、運転自体は自動運転だったそうです。

何かスマホでも見てるような動きですが、計器か何かを確認してるんでしょうね。

このオペレーターに過失があるかは不明。

米国運輸省道路交通安全局が定義する自動運転レベル「4」だったそうで。

それは「高度自動運転」と呼ばれるレベルで、

悪天候など特殊な条件を除く状況で自動運転を行うというもの。

特殊な条件下に備えてドライバーが同乗する必要はあるようです。

夜間のドライブが特殊な条件に該当するかは不明。

なので、捜査している最中らしい。

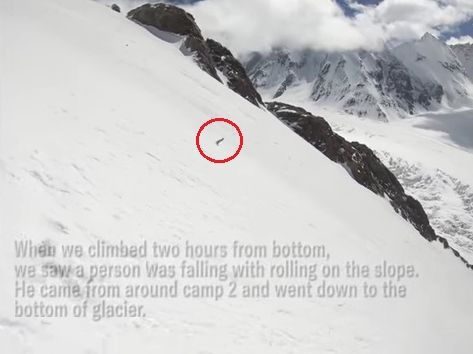

現地は本当は明るかったという疑惑

YouTuberが同じ場所を同じ時間帯に走行したら、

実は現地は明るかったという検証動画が上がってます。

動画の33~36秒が現場と投稿者は推測していますが

画面内の街灯が妙に明るすぎるので、輝度を上げている可能性が高い。

警察が公開した動画が輝度を下げたフェイク映像なら、

なぜ警察がそこまでしてUberを擁護するのか動機が不可解。

そもそも本当に同じ時間帯なのかも不明です。

当日も動画のようにちゃんと街灯が点いてたのかも不明です。

あと、同じ車種(Volvo XC90)には121~152メートル先まで照らせるハイビームがあり、

ハイビームを点灯しておけば横断者に気付いたはず、との指摘も。

Police chief said Uber victim “came from the shadows”—don’t believe it

でも、街中でハイビームなんか使いますかね……。

とは言え、やはりUberの自動運転車にはリモートセンシング装置の1つ「Lidar」とレーダーセンサーが搭載されていたそうです。

なので、ハイビームを点灯せずともLidarで横断者を感知できたはずです。

Lidarの故障か誤作動が事故原因じゃないかなと思います。

または服装がレーダーを吸収し、反射しづらい素材だったのかも。

Uberの事故車のセンサーは1つだけだった

事故を起こしたVolvo XC90にはLidarが1つしか搭載されてなかったようです。

Uber’s use of fewer safety sensors prompts questions after Arizona crash

一方、旧型のFord FusionはLidarが7つ搭載。

Lidarが1つなので、レーダーを10個搭載してたそうです。

しかし実際に事故を起こしてるのだから、不足でしょうね。

それにFordの方もレーダーは7個は搭載してるし、

カメラもVolvoが7つに対してFordは20個。

旧型の方は安全性に配慮してた事がわかります。

ライバルのWeymoではLidarを6つ搭載し、

ゼネラルモーターズでは5つ搭載してるそうです。

どうもUberは後発の自動運転車開発競争参入者なので、

開発を焦ってたのではないかという見方もあるようです。

ウーバーの自動運転は緊急停止装置が止まっていた

米運輸安全委員会の調査によると、

ウーバーの自動運転車が人身事故を起こしたとき、

緊急停止装置が止まっていたと判明。

ウーバー自動運転車、事故時は緊急停止モード設定せず=NTSB報告

ウーバー側は、装置のせいで運転の誤動作を防ぐ為に装置を止めてたと弁明。

それではいざという時に止まらないのは当然ですね。

やはり開発を焦っていたという見方が正しかった。

緊急停止装置が誤作動を起こすので、まともに走れなくなってたんでしょう。

それではデータが取れないので、装置を停止して一見スムースに走らせていた。

でも人身事故が起きて、緊急停止装置がまともに開発されていない事が露呈。

自動運転システム自体は事故の1.3秒前には緊急停止の判断を下していたそうです。

でも装置は止められてたので、車を停止させられなかった。

センサーが1つしか付いてなかったそうですが、

センサーの機能については十分で、落ち度はなかったんじゃないですかね。

また米運輸安全委員会の報告によると、跳ねられた被害者は覚醒剤とマリファナが検出されてたそうです。

だから横断歩道でもない場所を車の接近を確認もせずに暢気に渡ってたんでしょうね。

もちろん、この報告自体が被害者を貶める捏造の可能性も残りますが……。

オペレーターはHuluを視聴していた

記事タイトルは「運転手」だけど運転自体は自動運転で同乗してたのはオペレーターのはずです。

オペレーターは乗車中に携帯端末でHuluの「The Voice」を視聴していたとのこと。

「The Voice」とは音楽オーディション番組。

Uber car’s ‘safety’ driver streamed TV show before fatal crash: police

アリゾナ警察はオペレーターがちゃんと前を見ていれば事故は防げたと報告。

なのでオペレーターは殺人罪で起訴される可能性があるそうです。

でも緊急停止装置を切ってたのが根本原因じゃないんですかね……。

とは言え、Uberではオペレーターが携帯デバイスを使うのを禁止していたそうです。

よって、Uberとの契約違反ではあります。

オペレーターが緊急停止装置が切れていると知ってたかどうかが焦点になりそうですね。

Uberは歩行者が車道を渡る事を想定してなかった

アメリカの国家運輸安全委員会(NTSB)がUberの事故を調査したところ、

Uberの自動運転者は「車道を渡る歩行者」を想定してなかったと判明。

死亡事故を起こしたUberの自律走行車は、「車道を渡る歩行者」を想定していなかった:調査報告から明らかに

そもそもUber社内の「安全管理」部門も存在せず、Uberは安全性を軽視する社風だとわかります。

Uberの自動運転ソフトウェアは、衝突の危険を感知して1秒後に車輌が反応するようになっていました。

更に、車輌のボルボに元から組み込まれていた自動ブレーキを解除していました。

ボルボは「自動ブレーキが有効なら、衝突時にかなり減速できていたはず」だと指摘。

衝突しても軽傷で済んだか、そもそも衝突しなかった可能性が高いです。

ただし、専門家によるとこの措置自体は正しいようです。

2つの同種システムが混在すると車輌が誤作動を起こすので、どちらかを解除して誤作動を防ぐ方が良いと。

自動運転ソフトウェアが歩行者を認識したのは、衝突の5.6秒前。

その時点では「自動車」と判断していたようです。

その後「その他」と「自転車」を行ったり来たりして、最終的に「自転車」という判断に落ち着いていたと。

「謎の物体」が何であるかを判断する間、その物体が進む方向の予測を最初からやり直していたようです。

そして衝突の1.2秒前にブレーキをかける判断をしたものの、上述のとおり「1秒後に車輌が反応する」設定だったので、衝突してしまいました。